Viele Unternehmen verlieren täglich wertvolle Arbeitszeit – nicht, weil es an Kompetenz mangelt, sondern an klar zugänglichen Informationen. Neue wie auch erfahrene Mitarbeitende verbringen einen erheblichen Teil ihrer Zeit damit, Wissen zu suchen, Dokumente zu durchforsten oder Kolleginnen und Kollegen um Unterstützung zu bitten. Doch gerade diese sind oft selbst stark ausgelastet, sodass Rückfragen zu Verzögerungen, Unterbrechungen und unnötigen Reibungsverlusten führen.

Die Folge: Einarbeitungsprozesse ziehen sich in die Länge, Wissen bleibt fragmentiert und die Produktivität leidet – sowohl individuell als auch im Team.

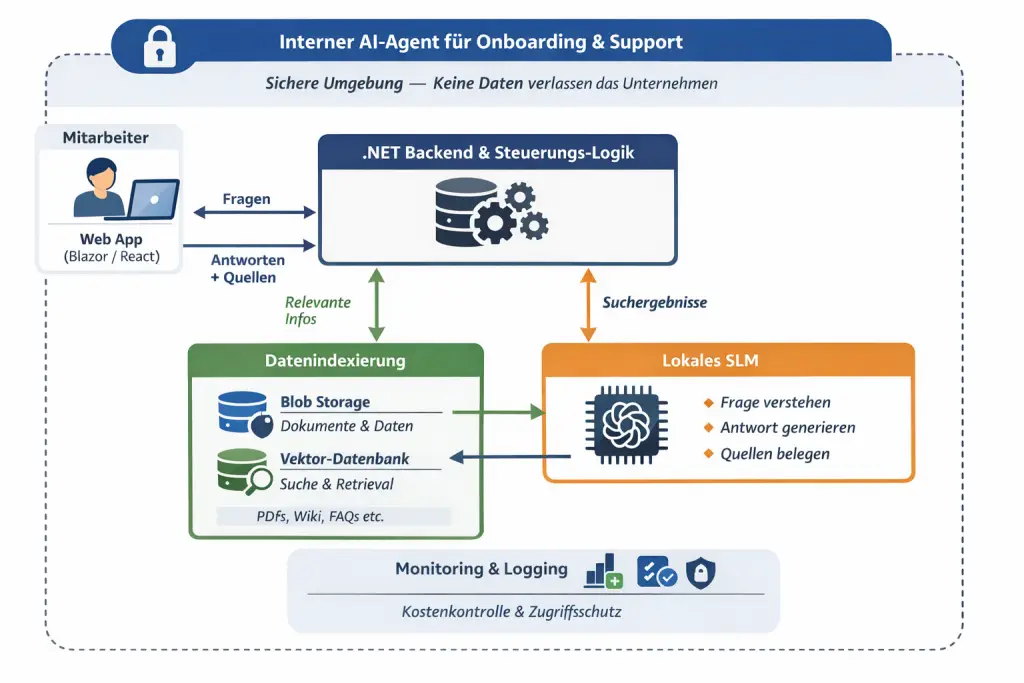

Die Lösung liegt in einer zentralen, jederzeit verfügbaren Wissensinstanz: Ein unternehmensinterner AI-Agent, der Mitarbeitenden schnell und zuverlässig präzise Antworten liefert – inklusive transparenter Quellenangaben. So wird relevantes Wissen unmittelbar zugänglich, Abhängigkeiten werden reduziert und Teams können effizienter zusammenarbeiten.

Zielbild

Ein intelligentes Tool, das:

Unternehmenswissen zentral zugänglich macht

Fragen in natürlicher Sprache beantwortet

Antworten mit Quellen belegt

Datenschutz- und Compliance-Anforderungen erfüllt

Nahtlos in bestehende Systeme integrierbar ist

Und das alles auf Basis eines modernen .NET- und Azure-Stacks.

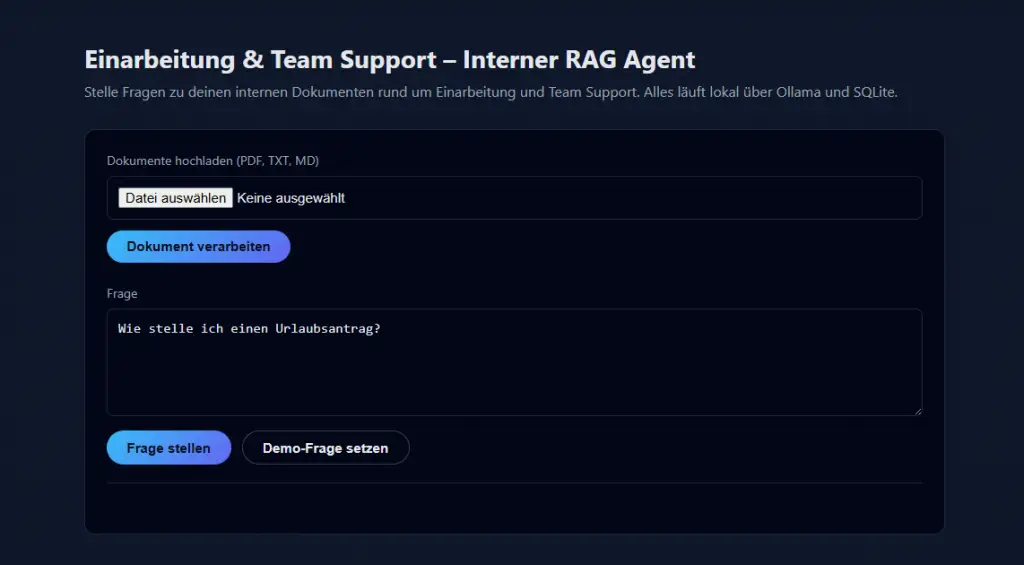

Lösungsansatz: AI-Agent mit Retrieval-Augmented Generation (RAG)

Der Kern der Lösung ist ein sogenannter RAG-Ansatz:

Datenquellen anbinden

Dokumente (PDF, Word, Confluence, SharePoint etc.)

FAQs, interne Wikis

Support-Tickets

Indexierung & Vektorsuche

Inhalte werden semantisch durchsuchbar gemacht.AI-Agent

Nutzer stellt eine Frage

System sucht relevante Inhalte

Antwort wird generiert – inkl. Quellenangaben

Datenschutz & Sicherheit

Vorteile der Azure-basierten Lösung:

Daten bleiben in der eigenen Tenant-Umgebung

Keine Nutzung für Modelltraining durch externe Anbieter

Granulare Zugriffskontrollen

DSGVO-konforme Infrastruktur

Zusätzlich möglich:

Dokumentenbasierte Zugriffsbeschränkungen

Logging & Audit-Trails

Architektur-Varianten je nach Sicherheitsanforderung

Die Lösung kann flexibel in zwei Modi betrieben werden:

🔒 Lokaler Modus (höchste Datensicherheit)

Lokales SLM (z. B. über Ollama)

Lokale Vektor-Datenbank

Keine externen Verbindungen

☁️ Cloud-Modus (höchste Leistungsfähigkeit)

Azure OpenAI

Azure AI Search

Skalierbare Infrastruktur

🔀 Hybrid-Modus (empfohlen)

Sensible Daten → lokal

Allgemeine Inhalte → Azure

Kosten (Hosting mit AI-Agent) - Beispielrechnung

Ich nehme ein realistisches KMU-Szenario an:

50–200 Mitarbeitende

500–5.000 Dokumente

100–1.000 Fragen pro Tag

1. AI-Kosten (Azure OpenAI)

Modell: GPT-4o-mini

Kosten: ca. $0.15 pro 1 Mio Input Tokens + $0.60 Output

Annahme:

1 Anfrage ≈ 2.000 Tokens gesamt

500 Anfragen/Tag

Rechnung:

500 × 2.000 Tokens = 1.000.000 Tokens/Tag

≈ $0.75 – $1.50 / Tag

Monatlich: ~25 – 50 €

2. Storage (Dokumente)

Azure Blob Storage: ~0.02 € pro GB

Beispiel:

– 10 GB Dokumente → ~0.20 € / Monat (vernachlässigbar)

3. Backend Hosting (.NET)

Option A: Azure App Service / Azure Functions (serverless)

Basic: ~12–50 € / Monat

Option B: Shared oder dedicated Server (z.B. bei Hetzner)

5 – 10 € / Monat

4. Azure AI Search (Vektor-Datenbank)

Zu Performance- und Kostenzwecken macht der Einsatz einer eigenen Vector Datenbank Sinn. So werden bereits gestellte Anfragen und Wissen in der Datenbank persistiert und die Generierung von neuen Tokens vermieden.

- Basic Tier: ca. ~75 – 100 € / Monat

Gesamtkosten pro Monat

- Azure OpenAI: 25 – 50 €

- Backend Hosting: 5- 50 €

- Vektor Datenbank: 75 – 100 €

Gesamtkosten: ~ 100 – 200 € pro Monat

Kostenrechner

Azure: https://azure.microsoft.com/de-de/pricing/calculator/

Hetzner: https://www.hetzner.com/cloud/

GitHub Repository

Der Code steht Ihnen lizenzfrei auf GitHub zur Verfügung und kann an Ihre eigenen Anforderungen angepasst werden: GitHub Repository